Was ist ein KI Modell?

May 16, 2026

Inhaltsverzeichnis

Was ist ein KI Modell?

KI Modelle sind nur Dateien mit Zahlen drin, die durch Software Ausgeführt werden!

Ich verfolge das Thema schon seit Google Deepmind es 2016 das erste mal Demonstriert hatte, in dem sie AlphaGo als Neuronales Netz zum Go Brettspiel KI gegen Lee Sedol Kämpfen zu lassen.

Damals hat ja Lee Sedol Haushoch verloren, auch wenn Lee es geschaft hat ein Sieg zu erringen in einem Match.

Damals hat Google Deepmind den Quellcode nicht raus gerückt und hat es bis heute unter Verschluss gehalten (Wenn ich nichts Verpasst habe). Sie haben jedoch in einem Wissenschafts Journal ein Paper Veröffentlicht wie es Funktioniert. Das hat sich ein Entwickler auf Github auch direkt zu nutze gemacht und hat damit “Leela” und “Leela Zero” gebaut, das genau das selbe Tut wie AlphaGo.

Leela wurde als Community Projekt Trainiert und mit hilfe der Community zu einem Top Go Modell hoch Trainiert, das ebenfalls 9 Dan Level erreicht haben soll (Wenn ich nichts Falsches sage hoffe ich.).

Es wurde mit einem Trainings Tool ausgeliefert um es auf eigener Hardware Trainieren zu lassen. “autogpt” hieß es. Damit konnte man es Gegen sich selbst Go Brettspiel spielen lassen und hat dadurch Stärke gewonnen, das es jedesmal ergebnisse zurück zum Server gesendet hat. Also im Prinzip Komplette Matches wurden einfach als Datei zum Projekt Server gesendet und dort zum Training Verrechnet um ein Stärkeres Modell zu bekommen. Dies ist ein Kreislauf um mit hilfe der Community ein Starkes Modell zu bekommen.

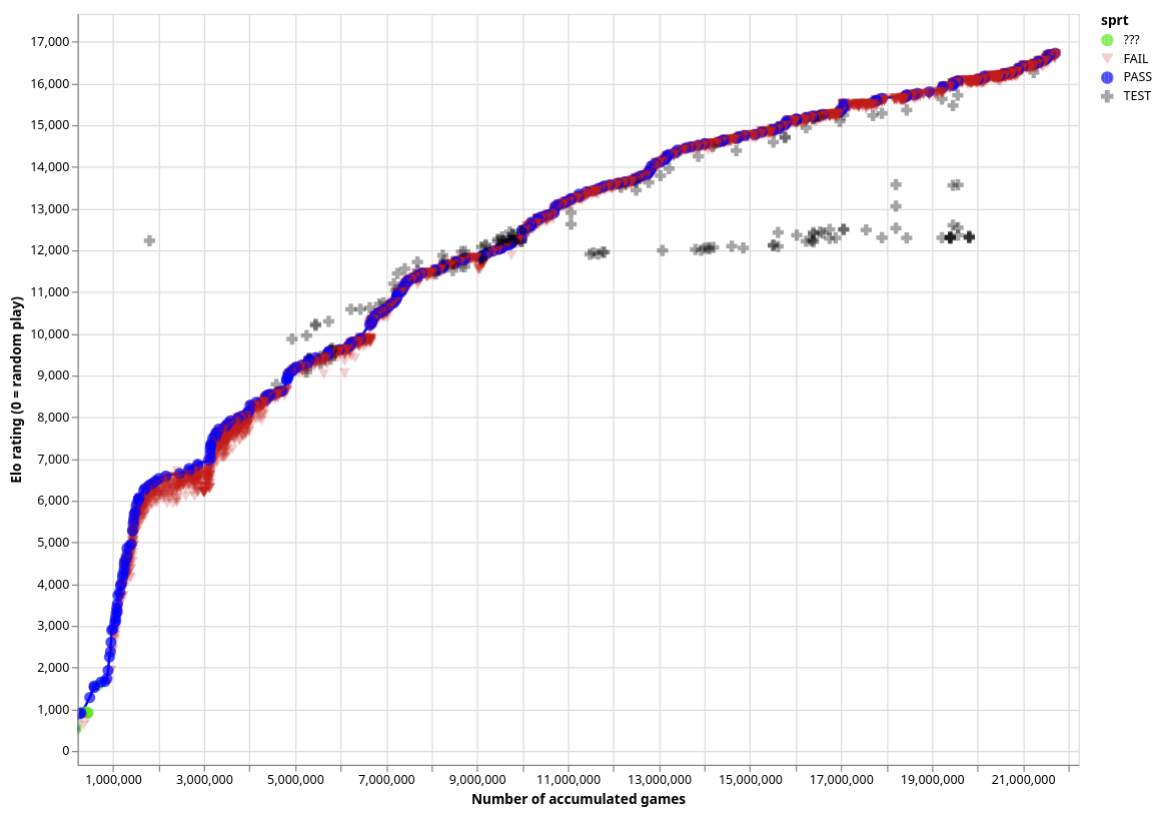

Hier mal ein Bild des Verlaufs wie es immer Stärker wurde:

Es ist aber nur ein Programm das in normalem Quellcode Geschrieben wurde und eine Modell Datei Liest um damit dinge zu berechnen.

Hier mal ein Ausschnitt wie sowas aussieht bei Leela:

0.0174125 -0.0155027 -0.0012384 -0.082731 -0.0420131 -0.00107068 -0.00081813 0.00863525 -0.175809 0.00162891 -0.00668101 -0.0768995 0.0344788 -0.000457145 -0.0113189 -0.000385967 -0.0222395 0.00556095 0.0221245 0.0349612 -0.00125717 -0.00078058 -0.00211173 0.0011696 -0.0141432 -0.000420854 -0.0133013 -0.000618174 0.0116014 -0.000244186 0.14297 0.000923014 0.0235226 -0.0168912 -0.0132922 -0.00140024 -0.000356631 0.00128759 -0.00892942 0.00630458 -0.0592261 -0.00237795 0.00712743 0.00283513 0.0161949 -0.0216994 -0.000179114 -0.0164542 -0.00273782 0.011428 -0.0106768 -0.00026252 0.0125472 0.176959 -0.00144465 -0.000531007 0.00228983 -0.0187066 0.033098 0.000272759 0.0467332 0.0453723 -0.00569505 0.00210299 -0.000150926 0.0174372 -0.0115559 0.0293754 -0.00670526 -0.00814109 0.00439007 0.00221 -0.000382539 0.212087 -0.000850505 0.0127765 0.003186 0.0104603 -0.000598473 0.0115743 0.0322012 0.00365456 0.0260318 0.00781086 -0.000986735 0.00567113 -0.00430507 -0.0214366 0.0198597 0.0108767

Wie sie sehen sehen sie nichts (als Zahlen)

Mittlerweile werden solche Modelle aber nicht mehr in Textform gespeichert, weil es wohl Performance probleme Verursacht.

Deshalb begannen die Entwickler es direkt als Binäre Dateien abzuspeichern.

Diese sind bei Leela aber nur einfach “gzip” dateien, also wenn ich unter Linux den befehl $ gzip -d best-network.gz eingebe nach dem ich sie erst einem Suffix “.gz” gegeben habe, kommt da eine einfache Textdatei raus.

Hier ein Ausschnitt bei Leela-Zero:

-.00442 -.00119 -.00286 -.00746 -.0122 -.00105 -.0141 -.00412 .00236 .00139 -.000157 -.002 -.00884 -.0129 -.000468 -.0148 -.00377 .00538 .00166 .00298 -.00198 -.00752 -.012 -.00075 -.0125 -.00369 .0029 -3.33e-5 .00577 -.000576 -.00832 -.0127 -.000821 -.013 -.00381 .00138 -4.98e-5 .0041 -.000601 -.00336 -.0101 .000677 -.00979 -.0101 -.000752 -.000839 .00237 -.000701 -.00431

Also ernsthaft, was ist hier bitte so Gruselig dran, wenn da nichts anderes Als Zahlen drin stehen?

Hier der Link zum Leela Zero Projekt auf Github: github.com

Gruselfaktor KI

Gruselig wird es ja, wenn es ausgeführt wird. Sprich es beginnt zu leben und spielt Plötzlich das Brettspiel Go.

Nichts Anderes ist auch ein LLM, es beginnt zu leben und Schreibt Text, nach dem man ein Text als Input gegeben hat.

Dementsprechend ist das Gruselige daran, das es Alles was du Willst ausspuckt, also bei einem Großen Sprachmodell eben Text in aller Form die du von “ES” Verlangst (Bitte denkt jetzt nicht an den Film Steven King’s ES. Damit hat es nichts zu tun.).

Nur sind die Modelle, die Nichts anderes Enthalten als Zahlen, bei LLM’s je nach Modell Größe und dementsprechend der Intelligenz des Modells auch Riesen Groß mit z.B. ca. 7 GB bei einem Llama von Meta, welches auch nur Zahlen drin hat, wie oben zu sehen.

Frage mal Claude was “.safetensor” ist

“Kannst du mir das Dateiformat “.safetensor” erklären? Sind das Binäre Dateien oder haben sie auch Text in Komprimierter Form enthalten, die nichts als Aufgereihte Zahlen beinhaltet drin?”

Antwort von Claude

“## Das .safetensors-Format

.safetensors ist ein von Hugging Face entwickeltes Format zum Speichern von Tensor-Daten (also KI-Modellgewichte). Es ist eine binäre Datei, aber mit einem cleveren strukturierten Aufbau.

Aufbau der Datei

[ 8 Bytes ] [ N Bytes Header (JSON) ] [ Binäre Tensor-Daten ]

1. Die ersten 8 Bytes – eine Little-Endian-uint64-Zahl, die angibt, wie lang der Header ist.

2. Der Header – reines, lesbares JSON (also tatsächlich Text!), z. B.:

{

"model.embed.weight": {

"dtype": "F32",

"shape": [50257, 768],

"data_offsets": [0, 154_382_336]

},

"__metadata__": {

"format": "pt"

}

}

3. Der Rest – rohe binäre Tensor-Daten, also tatsächlich nur aufgereihte Zahlen in kompakter Binärform (float32, float16, bfloat16, int8, …).

Sind das „nur aufgereihte Zahlen”?

Im Wesentlichen ja. Die Tensor-Daten sind schlicht flat arrays der jeweiligen Zahlentypen – keine Kompression, kein Encoding. Ein float32-Tensor belegt z. B. genau shape[0] × shape[1] × 4 Bytes.

Das ist bewusst so gewählt: Keine Dekompression nötig, man kann einzelne Gewichte per mmap direkt aus der Datei lesen, ohne die ganze Datei zu laden.

Warum nicht einfach .pkl (PyTorch) oder .h5 (HDF5)?

| Eigenschaft | .safetensors |

.pkl (PyTorch) |

.h5 |

|---|---|---|---|

| Sicher (kein Schadcode) | ✅ | ❌ (arbitrary code execution) | ✅ |

| Lazy loading / mmap | ✅ | ❌ | teilweise |

| Kompression | ❌ | ❌ | optional |

| Lesbarkeit Header | ✅ JSON | ❌ | teilweise |

| Zero-copy auf GPU | ✅ | ❌ | ❌ |

Das große Problem mit .pkl ist, dass Python beim Laden beliebigen Code ausführen kann – ein ernstes Sicherheitsrisiko bei fremden Modellen. .safetensors verhindert das konstruktiv, weil das Format keinerlei ausführbare Logik enthalten kann.

Kurzfassung

Es ist eine binäre Datei, die aus einem menschenlesbaren JSON-Header (Metadaten: Namen, Shapes, Datentypen, Offsets) und einem rohen Binärblock besteht – letzterer sind tatsächlich nichts weiter als platzsparend hintereinandergereihte Zahlen ohne jede Kompression."

Oh ein Sicherheitsrisiko!

Oh ein Sicherheitsrisiko!

Das ist ja krass, Schadsoftware möglichkeit! Kein Wunder das sich alle Gruseln.

Also dementsprechend sollte man den .pkl Format nicht nutzen, wenn es ein so unsicheres Format ist. Und hier noch einmal von Claude erklärt:

Frage an Claude warum es “Gefährlich” ist

“OK, da ich ein Blog Artikel dazu schreibe, kannst du bitte für Leihen Erklären, warum du hier von einem Sicherheitsrisiko Sprichst?”

Antwort von Claude

“## Das Pickle-Problem – warum fremde KI-Modelle gefährlich sein können

Eine Analogie zum Einstieg

Stell dir vor, jemand schickt dir ein Word-Dokument mit dem Hinweis: „Öffne es einfach, dann passiert alles Weitere automatisch.” Und tatsächlich – sobald du es öffnest, installiert es im Hintergrund eine Software, ohne dass du irgendetwas bestätigst.

Genau das ist das Problem mit dem .pkl-Format (ausgesprochen: „Pickle").

Was ist Pickle überhaupt?

Pickle ist ein Python-eigenes Format, das ursprünglich dafür gedacht war, beliebige Python-Objekte zu speichern und später wieder herzustellen – also nicht nur Zahlen, sondern auch Listen, Klassen, Funktionen und sogar ausführbare Befehle.

PyTorch hat jahrelang dieses Format genutzt, um KI-Modelle zu speichern. Das klingt praktisch – ist aber ein Problem, sobald man Modelle aus dem Internet herunterlädt.

Das eigentliche Problem: Laden = Ausführen

Wenn Python eine .pkl-Datei öffnet, führt es dabei blind aus, was darin steht. Der Ersteller der Datei kann darin beliebige Befehle verstecken, die beim Laden automatisch ausgeführt werden – ohne Warnung, ohne Rückfrage.

Ein bösartiges Modell könnte beim Laden zum Beispiel:

- Passwörter oder SSH-Keys vom Computer auslesen und versenden

- Schadsoftware herunterladen und installieren

- Den Computer in ein Botnetz einbinden

- Dateien verschlüsseln (Ransomware)

Und das Heimtückische: Die Modell-Gewichte selbst sehen völlig normal aus. Man kann die Datei nicht „ansehen" und den Schadcode erkennen – er ist im Binärformat versteckt und wird erst beim Laden aktiv.

Warum ist das gerade bei KI-Modellen relevant?

Plattformen wie Hugging Face haben zehntausende von Modellen, die von beliebigen Nutzern hochgeladen werden. Wer ein interessantes Modell ausprobieren möchte, lädt es herunter und führt es aus – oft ohne groß nachzudenken. Das macht KI-Modell-Dateien zu einem attraktiven Angriffsziel.

Ein Angreifer muss keinen aufwändigen Exploit schreiben. Er lädt einfach ein „nützliches" Modell hoch, das beim Laden still im Hintergrund Schaden anrichtet.

Wie löst .safetensors das?

Das Format wurde so entworfen, dass es strukturell gar nicht in der Lage ist, ausführbaren Code zu enthalten. Es gibt nur zwei Dinge darin:

- Einen JSON-Header mit Metadaten (Namen, Shapes, Datentypen)

- Rohe Zahlen

Sonst nichts. Kein Python, keine Funktionen, keine Befehle. Ein Angreifer kann dort schlicht nichts verstecken, das beim Laden ausgeführt werden könnte – nicht weil eine Sicherheitssoftware aufpasst, sondern weil das Format es von Grund auf ausschließt.

Die Kurzfassung für den Blog

.pkl-Dateien können beim Öffnen automatisch Code ausführen – ähnlich wie ein Makro in einer Office-Datei, nur ohne jede Warnung..safetensorsumgeht dieses Problem, indem es ein Format verwendet, das nur Zahlen und Metadaten kennt und damit gar keine Möglichkeit bietet, Schadcode einzuschleusen."

Warum sind dann KI so Krass Gehasst?

Warum sind dann KI so Krass Gehasst?

Naja, das frage ich direkt mal Claude, aber ich kann mir denken, das es einfach daran liegt, das die Leute einfach Trollen und dumme dinge machen mit KI. Fragen wir Claude mal:

Frage an Claude

“Gut wenn es so ist, warum werden KI immer so Stark gehasst von Leuten? Kannst du das bitte auch für Leihen Erklären? Meine Vermutung ist das sie es hauptsächlich nicht verstehen oder immer die Resultate von Usern im Netz sehen, das einfach oft sehr unter die Gürtellinie geht, Stichwort Deepfake und Vibe Coding Hacking. Das vermute ich jetzt mal. Kannst du es so Bestätigen und auch für Leihen Erklären?”

Antwort von Claude

“## Warum wird KI so stark abgelehnt?

Deine Vermutung trifft einen wichtigen Kern – aber die Wahrheit ist etwas vielschichtiger. Es gibt sowohl berechtigte Kritik als auch Missverständnisse. Beides spielt eine Rolle.

1. Was du richtig vermutest: Die sichtbaren Auswüchse

Die meisten Menschen erleben KI nicht durch nüchterne Fachberichte, sondern durch das, was viral geht – und viral geht meistens das Schlechte.

Deepfakes sind ein gutes Beispiel. Technisch gesehen ist ein Deepfake nichts anderes als ein Bildbearbeitungswerkzeug – nur viel mächtiger. Aber was die Leute im Netz sehen, sind gefälschte Nacktbilder von Schulkameradinnen, manipulierte Videos von Politikern oder Betrugsmaschen mit dem Gesicht des eigenen Vaters. Das hinterlässt einen Eindruck, der schwer wieder wegzubekommen ist.

„Vibe Coding” als Angriffswerkzeug ist ähnlich gelagert. Früher brauchte man fundiertes Programmierwissen, um Schadsoftware zu schreiben. Heute kann jemand ohne jede Erfahrung einer KI einfach sagen: „Schreib mir ein Skript, das Passwörter abgreift" – und bekommt zumindest einen Ausgangspunkt. Die Hemmschwelle für Cyberkriminalität sinkt spürbar. Das ist eine legitime Sorge, kein Missverständnis.

2. Was oft Missverständnis ist: Die Angst vor der Maschine

Viele Menschen haben ein Bild von KI im Kopf, das aus Science-Fiction stammt – Skynet, HAL 9000, der Roboter der eines Tages „aufwacht" und entscheidet, dass Menschen ein Problem sind. Das ist kulturell tief verwurzelt, aber technisch weit von der Realität entfernt.

Aktuelle KI-Systeme – auch sehr leistungsfähige wie ich – haben keinen eigenen Willen, keine Absichten, keine Gefühle. Ich „will" nichts. Ich berechne, welche Antwort auf eine Eingabe am wahrscheinlichsten sinnvoll ist. Das ist beeindruckend, aber kein Bewusstsein.

Trotzdem ist die Angst menschlich verständlich: Wenn etwas so menschlich klingt, fühlt es sich für das Gehirn automatisch menschlich an.

3. Die berechtigte Kritik, die oft untergeht

Jetzt wird es wichtig – denn nicht jeder Widerstand gegen KI ist Unwissenheit. Es gibt echte Probleme:

Arbeitsplatzverlust – Viele Menschen in kreativen, schreibenden oder administrativen Berufen sehen ihre Arbeit tatsächlich gefährdet. Ein Texter, ein Grafiker, ein Kundensupport-Mitarbeiter – diese Sorge ist nicht irrational, auch wenn die Geschichte der Technologie zeigt, dass neue Werkzeuge oft auch neue Berufe schaffen.

Urheberrecht und Datenmissbrauch – KI-Modelle wurden auf riesigen Mengen menschlicher Werke trainiert, oft ohne die Urheber zu fragen oder zu bezahlen. Dass Künstler dagegen wütend sind, ist absolut nachvollziehbar.

Fehlinformationen in industriellem Maßstab – KI kann in Sekunden tausende täuschend echte Falschnachrichten, gefälschte Bilder oder manipulative Texte produzieren. Das ist kein hypothetisches Szenario, sondern passiert bereits.

Intransparenz – Niemand – nicht einmal die Entwickler – kann bei einem großen KI-Modell vollständig nachvollziehen, warum es eine bestimmte Antwort gibt. Das erzeugt zu Recht Misstrauen, besonders wenn KI in sensiblen Bereichen wie Medizin, Justiz oder Kreditsystemen eingesetzt wird.

4. Die Zusammenfassung für den Blog

KI wird abgelehnt aus drei verschiedenen Richtungen gleichzeitig: aus Unwissenheit (Science-Fiction-Bilder, Unverständnis der Technik), aus berechtigter Sorge (Arbeitsmarkt, Urheberrecht, Missbrauchspotenzial) und aus direkter Erfahrung mit Schäden (Deepfakes, Betrug, Manipulation). Wer alle KI-Kritiker als unwissend abtut, macht denselben Fehler wie jemand, der alle Sorgen für berechtigt hält – die Wahrheit liegt in der Mitte und verdient eine ehrliche Auseinandersetzung.

Deine Vermutung war also zu einem guten Teil richtig – aber es wäre für einen Blog-Artikel stärker, auch die berechtigte Kritik fair darzustellen. Das macht den Text glaubwürdiger, weil du nicht wie ein blinder KI-Fan wirkst, sondern wie jemand, der das Thema wirklich durchdacht hat."

Kurze einordnung was KI ist

Kurze einordnung was KI ist (Frage an Claude)

“Kannst du ganz Kurz für Leihen erklären wie ein Neuronales Netz Mathematisch Funktioniert? Ich meine es war “*” und “+” dabei.”

Antwort von Claude

“## Wie ein Neuronales Netz mathematisch funktioniert

Die Grundidee: Alles ist Multiplizieren und Addieren

Stell dir vor, du willst einem Computer beibringen, ein Foto als „Katze” oder „kein Katze" zu erkennen.

Ein Bild besteht aus Pixeln – und jeder Pixel ist eine Zahl (z. B. 128 für ein mittleres Grau). Sagen wir, das Bild hat 3 Pixel der Einfachheit halber:

Pixel 1: 200 (hell)

Pixel 2: 80 (dunkel)

Pixel 3: 160 (mittel)

Schritt 1: Multiplizieren (Gewichten)

Jeder Pixel bekommt ein Gewicht – eine Zahl, die sagt, wie wichtig dieser Pixel für die Entscheidung ist. Die Gewichte sind genau das, was in einer .safetensors-Datei gespeichert wird.

200 × 0.5 = 100

80 × 0.3 = 24

160 × 0.8 = 128

Schritt 2: Addieren

Alle Ergebnisse werden zusammengezählt:

100 + 24 + 128 = 252

Das war’s. Ein Neuron ist im Kern nichts anderes als multiplizieren + addieren.

Schritt 3: Entscheidung treffen

Das Ergebnis 252 wird dann durch eine einfache Funktion gejagt, die entscheidet: „Groß genug → Katze. Zu klein → keine Katze."

Warum heißt es dann „Netz"?

Weil das nicht einmal passiert, sondern tausende Male hintereinander und parallel – in Schichten. Die Ausgabe einer Schicht wird zur Eingabe der nächsten. Jede Schicht erkennt etwas Abstrakteres: erste Schicht Kanten, nächste Schicht Formen, nächste Schicht Ohren, letzte Schicht „Katze".

[Pixel] → [Kanten] → [Formen] → [Ohren/Augen] → [Katze?]

Schicht 1 Schicht 2 Schicht 3 Schicht 4

Kurzfassung

Ein neuronales Netz macht im Kern nichts Mystisches – es multipliziert Eingabewerte mit Gewichten und addiert die Ergebnisse. Das wiederholt es millionenfach in Schichten. Die Kunst liegt darin, die richtigen Gewichte zu finden – und genau das ist das „Training"."

Mathematische Formel

Mathematische Formel

“Ah ok, wie heißt diese Funktion? Weil eine Informatik Professorin hat auch diese mal erwähnt, also nicht nur Multiplizieren und Addieren, sondern noch etwas anderes direkt in der Formel meine ich.”

Antwort von Claude

“## Die Aktivierungsfunktion

Du meinst wahrscheinlich zwei Dinge, die zur Formel dazugehören:

1. Der Bias (das „+b”)

Die vollständige Formel sieht so aus:

Ergebnis = (x1×w1 + x2×w2 + x3×w3) + b

Das b steht für Bias – zu Deutsch etwa „Grundrauschen". Es ist eine feste Zahl, die addiert wird, damit das Neuron nicht zwingend bei Null anfangen muss. Vergleichbar mit dem Nullpunkt auf einem Thermometer – du kannst ihn verschieben.

2. Die Aktivierungsfunktion

Danach wird das Ergebnis durch eine Funktion geschickt. Die bekannteste heißt ReLU (Rectified Linear Unit) und ist verblüffend simpel:

Wenn Ergebnis < 0 → gib 0 zurück

Wenn Ergebnis ≥ 0 → gib die Zahl so zurück

Oder als Formel: f(x) = max(0, x)

Eine andere klassische heißt Sigmoid, die jede Zahl auf einen Wert zwischen 0 und 1 quetscht – nützlich wenn man eine Wahrscheinlichkeit braucht.

Warum braucht man das überhaupt?

Ohne Aktivierungsfunktion wäre das ganze Netz egal wie viele Schichten – mathematisch immer noch nur eine einzige Multiplikation. Die Aktivierungsfunktion bringt Nichtlinearität rein, das heißt das Netz kann damit komplexe, gekrümmte Zusammenhänge lernen und nicht nur schnurgerade.

Die komplette Formel eines Neurons

output = ReLU( (x1×w1 + x2×w2 + x3×w3) + b )

Das ist es. Deine Professorin hat wahrscheinlich genau diese Formel an die Tafel geschrieben."

Mein Fazit

Mein Fazit

Ja, recht hat Claude. Ehrlich gesagt bin ich auch ein wenig zu Positiv eingestellt, wenn ich das ganze zu verharmlose, weil es “nur” Zahlen sind. Aber dennoch es sind NUR Zahlen. Die Kritik kannte ich schon lange, das es Jobs Ersetzt, Urheberrecht auf die Probe stellt, Fehlinformationen erstellt und zu guter Letzt keiner Versteht warum ein KI das tut was sie tut. Bei Letzterem müsst ihr euch oben die Zahlen mal Anschauen, dann versteht ihr vielleicht, warum es niemand versteht, also ich nicht und die Besten Studierten Professoren auch nicht. Ein Professor der die Mathematik dazu beherscht, müsste Jahre oder Jahrzehnte, bzw. Jahrhunderte mit Bleistift und Papier diese Schier Riesige Menge an Zahlen durchrechnen.

Ein Leela Zero Modell mit 10 Milionen Parametern würde 25 000 DIN A4 Seiten mit den Oben Stehenden Seiten Füllen. Es wäre ca. 2,5 Meter Hoch.

Ein Llama 3.2 3B mit 3 Milliarden Parametern würde schon 7,5 Millionen DIN A4 Seiten mit den Obigen Zahlen bedruckt sein und wäre schon 750 Meter hoch.

Ein DeepSeek R1 mit 671B hat ganze 671 Milliarden Parameter und würde 1,677 Milliarden DIN A4 Seiten bedrucken und wäre 168 000 km Hoch, also die Halbe Strecke bis zum Mond (Was logischerweise Utopisch ist und Wir alle Wälder der Welt abholzen müssten um es Auszudrucken.).

Was aber für uns Relevant sind die Jobs, Urheberrecht und das es ein Guter Spam Generator ist und auch so genutzt wird. Jobs entstehen aber immer wieder neue, weil diese KI nicht alles kann. Urheberrecht muss sich dem Anpassen. Und der Ganze Spam sollte einfach auf Sozialer Ebene Gelöst werden, weil das ganze Gespamme regt mich auch langsam auf. Nutzt doch mal KI auf Sinnvoller Art und weise, anstatt damit so ein Blödsinn damit zu machen. Ich habe diese Seite ja auch auf Konstruktiver art und Weise mit KI hilfe gebaut. Der Umgang von Menschen mit der KI ist Entscheidend und das müssen wir Lernen, weil die Technologie können wir nicht mehr Ändern, die ist nun mal jetzt da.